关于军刀的简介:

Sabre 是 Google 创建的一种合并方法,也叫Super Res Zoom,“超分辨率”。最简单理解,就是该算法是一种超越物理光学变焦的谷歌大法独特数码变焦算法。再叠加HDR+ZSL,即高动态范围成像增强版,谷歌可以拍出来超细节的照片。这也是谷歌除夜视以外,非常核心的算法了。目前Sabre也不断进阶到了最新的合并算法,最新的shasta和RGB同时也加强了包围曝光、降噪等方面。可在某些模式下提高照片质量。由于清晰度/细节改进,有些人称其为“超分辨率”。Google 将它用于 Night Sight,但一些 GCam 模组也将其用于缩放照片和 HDR+ 增强。适用于 RAW10 格式(其他 RAW 格式可能会产生黑色照片)。

有时并非所有相机传感器都支持 Sabre(例如:非索尼传感器),并且 Google 相机会在拍照后崩溃。在这种情况下,唯一的解决方案是禁用 Saber(仅在某些模组上可用)并重新启动应用程序。

Sabre完美传感器:当然是Sony大法啦~, 目前第一的IMX989最香!

2018 年 10 月 15 日,星期一

作者:软件工程师 Bartlomiej Wronski 和计算成像首席科学家 Peyman Milanfar

(2020 年 8 月 6 日更新:本博文中描述的工作已在SIGGRAPH 2019上发表,并已发表在ACM Transactions on Graphics 上。)使用算法(而不是镜头)的数字变焦长期以来一直是移动设备相机的“丑小鸭”。与数码单反相机的光学变焦能力相比,数码变焦图像的质量没有竞争力,传统观点认为,更大的相机复杂的光学和机制无法被更紧凑的移动设备相机和智能算法所取代.

借助 Pixel 3 上新的 Super Res Zoom 功能,我们正在挑战这一概念。

Pixel 3 中的 Super Res Zoom 技术不同于以往任何基于放大单个图像裁剪的数字缩放技术,而且更好,因为我们合并了许多帧直接到更高分辨率的图片上。这大大改善了细节,与许多其他智能手机上的 2 倍光学变焦镜头大致相当。Super Res Zoom 意味着如果你在按下快门之前捏拉变焦,你会在照片中获得比之后裁剪更多的细节。

数码变焦的挑战

数码变焦很困难,因为一个好的算法应该从较低分辨率的图像开始,并可靠地“重建”丢失的细节——在典型的数码变焦中,单个图像的一小部分被放大以产生更大的图像. 传统上,这是通过线性插值方法完成的,该方法试图重新创建原始图像中不可用的信息,但会引入缺乏纹理和细节的模糊或“可塑性”外观。相比之下,大多数现代单图像升频器使用机器学习(包括我们自己早期的工作,RAISR)。这些放大了一些特定的图像特征,例如直边,甚至可以合成某些纹理,但它们无法恢复自然的高分辨率细节。虽然我们仍然使用 RAISR 来增强图像的视觉质量,但 Super Res Zoom 提供的大部分改进的分辨率(至少对于 2-3 倍这样的适度缩放系数)来自我们的多帧方法。

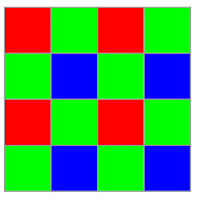

彩色滤光片阵列和去马赛克

重建精细细节尤其困难,因为数码照片已经不完整——它们是通过称为去马赛克的过程从部分颜色信息重建的。在典型的消费类相机中,相机传感器元件仅用于测量光的强度,而不是直接测量其颜色。为了捕捉场景中存在的真实颜色,相机使用放置在传感器前面的滤色器阵列,以便每个像素仅测量一种颜色(红色、绿色或蓝色)。它们以拜耳模式排列,如下图所示。

然后,相机处理管道必须在给定这些部分信息的情况下重建真实颜色和所有像素的所有细节。*去马赛克首先对丢失的颜色信息进行最佳猜测,通常是从附近像素中的颜色进行插值,这意味着 RGB 数字图片的三分之二实际上是重建!

在最简单的形式中,这可以通过对相邻值进行平均来实现。大多数真正的去马赛克算法都比这更复杂,但它们仍然会导致不完美的结果和伪影——因为我们仅限于部分信息。虽然这种情况即使对于大画幅数码单反相机也存在,但它们更大的传感器和更大的镜头可以捕捉到比移动相机更常见的细节。

如果您在移动设备上进行捏拉缩放,情况会变得更糟;然后算法被迫再次通过附近像素的插值来弥补更多信息。然而,并不是所有的都丢失了。这就是连拍摄影和多幅图像融合可用于实现超分辨率的地方,即使受到移动设备光学器件的限制。

从连拍到多帧超分辨率

虽然单帧不能提供足够的信息来填充缺失的颜色,但我们可以从连续拍摄的多张图像中获得一些缺失的信息。捕捉和组合多张连续照片的过程称为连拍摄影。谷歌的HDR+ 算法已成功应用于 Nexus 和 Pixel 手机,它已经使用来自多帧的信息使手机中的照片达到了更大传感器所期望的质量水平;可以使用类似的方法来提高图像分辨率吗?

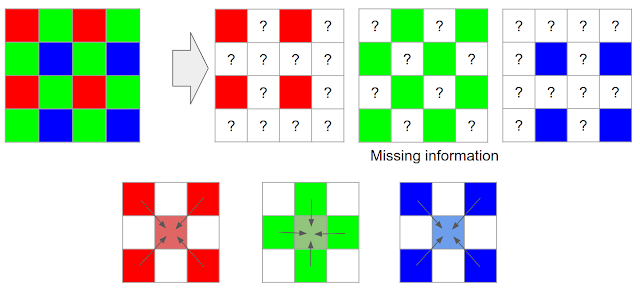

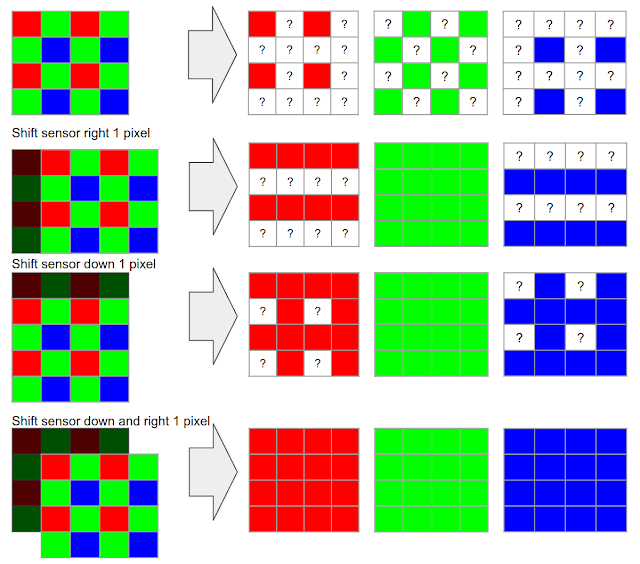

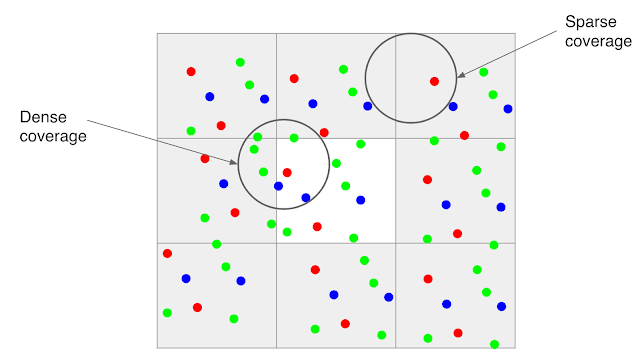

它已为人所知十多年了,包括在天文学中,基本概念被称为“毛毛雨”,捕捉和组合多个从稍微不同的位置拍摄的图像可以产生与光学变焦相当的分辨率,至少在 2 倍或 3 倍等低放大倍率和良好的照明条件下。在这个称为多帧超分辨率的过程中,总体思路是将低分辨率突发对齐并直接合并到所需(更高)分辨率的网格上。这是一个理想化的多帧超分辨率算法如何工作的示例:

在上面的示例中,我们捕获了 4 帧,其中三帧移动了一个像素:水平、垂直以及水平和垂直方向。所有的洞都会被填满,根本不需要任何去马赛克!事实上,一些数码单反相机支持这种操作,但前提是相机安装在三脚架上,并且传感器/光学元件主动移动到不同的位置。这有时被称为“微步进”。

多年来,这种用于更高分辨率成像的“超分辨率”方法的实际使用主要局限于实验室,或者传感器和对象对齐并且它们之间的移动被故意控制或严格限制的其他受控设置. 例如,在天文成像中,静止的望远镜可以看到可预测的移动天空。但在现代智能手机等广泛使用的成像设备中,超分辨率在移动设备相机等应用中的实际应用仍然遥不可及。

这部分是因为为了使其正常工作,需要满足某些条件。首先,也是最重要的一点,镜头需要比所使用的传感器更好地解析细节(相比之下,您可以想象这样一种情况,即镜头设计得如此糟糕,以至于添加更好的传感器并没有带来任何好处)。此属性通常被视为数码相机的一种不需要的伪影,称为混叠。

图像混叠

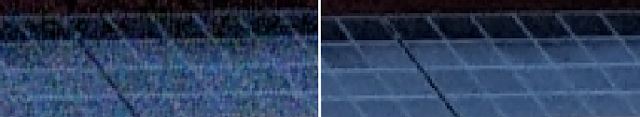

当相机传感器无法忠实地表示场景中存在的所有模式和细节时,就会出现混叠。混叠的一个很好的例子是莫尔图案,有时由于衣橱选择不当而出现在电视上。此外,当物体在场景中移动时,物理特征(例如桌子的边缘)的混叠效果会发生变化。您可以在以下连拍序列中观察到这一点,其中在连拍序列期间相机的轻微运动会产生随时间变化的混叠效果:

然而,这种行为是因祸得福:如果分析产生的图案,它会为我们提供各种颜色和亮度值,如上一节所述,以实现超分辨率。尽管如此,仍然存在许多挑战,因为实际的超分辨率需要与手持手机和任何突发序列一起使用。

使用手部运动的实用超分辨率

如前所述,一些数码单反相机提供特殊的三脚架超分辨率模式,其工作方式与我们目前所描述的类似。这些方法依赖于相机内部传感器和光学器件的物理运动,但需要相机完全稳定,这在移动设备中是不切实际的,因为它们几乎总是手持的。这似乎为移动平台上的超分辨率成像创造了一个 catch-22。

然而,我们通过利用手部动作来将这个困难转变为我们的优势。当我们用手持相机或手机拍摄一连串照片时,帧之间总是存在一些运动。光学防抖(OIS) 系统可以补偿较大的相机运动——通常在相隔 1/30 秒的连续帧之间有 5-20 个像素——但无法完全消除每个人都会出现的更快、幅度更低、自然的手部颤抖(即使是那些“稳定手”)。当使用带有高分辨率传感器的手机拍照时,这种手颤的幅度只有几个像素。

要利用手颤,我们首先需要将连拍的图片对齐在一起。我们选择突发中的单个图像作为“基础”或参考帧,并相对于它对齐每隔一个帧。对齐后,图像大致组合在一起,如本文前面所示的图表所示。当然,握手不太可能将图像精确地移动单个像素,因此在将颜色注入基本帧的像素网格之前,我们需要在每个新捕获的帧中的相邻像素之间进行插值。

当由于设备完全稳定(例如放置在三脚架上)而没有手部运动时,我们仍然可以通过故意“摇晃”相机来实现模拟自然手部运动的目标,方法是强制 OIS 模块在两次拍摄之间稍微移动. 这种移动非常小,并且选择不会干扰普通照片 – 但您可以通过将手机完全静止(例如将其压在窗户上)并最大限度地捏合缩放取景器,在 Pixel 3 上自己观察它. 在远处的物体中寻找微小但连续的椭圆运动,如下图所示。

克服超分辨率的挑战

我们上面给出的理想过程的描述听起来很简单,但超分辨率并不是那么容易——它没有广泛用于手机等消费产品的原因有很多,需要开发重大的算法创新。挑战可能包括:

- 即使在良好的照明条件下,连拍中的单张图像也很嘈杂。一个实用的超分辨率算法需要意识到这种噪声并尽管它正常工作。我们不想只获得更高分辨率的噪点图像——我们的目标是既提高分辨率又产生噪点少得多的结果。

上述所有挑战似乎使现实世界的超分辨率在实践中不可行,或者充其量仅限于静态场景和放置在三脚架上的相机。借助 Pixel 3 上的 Super Res Zoom,我们开发了一种稳定且准确的突发分辨率增强方法,该方法使用自然的手部动作,并且足够强大和高效,可以部署在手机上。

以下是我们如何应对其中一些挑战:

为了有效地合并突发中的帧,并在不需要去马赛克的情况下为每个像素生成红色、绿色和蓝色值,我们开发了一种跨帧集成信息的方法,该方法考虑了图像的边缘,并适应因此。具体来说,我们分析输入帧并调整我们如何将它们组合在一起,在细节和分辨率的增加与噪声抑制和平滑之间进行权衡。我们通过沿明显边缘的方向合并像素来实现这一点,而不是跨越它们。最终效果是我们的多帧方法在降噪和细节增强之间提供了最佳的实际平衡。

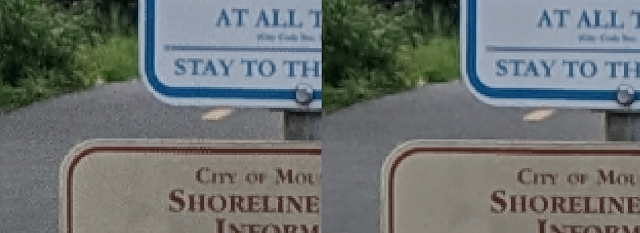

左:降噪和增强分辨率的次优折衷的合并图像。右图:具有更好折衷的相同合并图像。

- 为了使算法可靠地处理具有复杂局部运动(人、汽车、水或树叶移动)的场景,我们开发了一个鲁棒性模型来检测和减轻对齐错误。我们选择一帧作为“参考图像”,只有当我们确定我们找到了正确的对应特征时,才将来自其他帧的信息合并到其中。通过这种方式,我们可以避免“重影”或运动模糊等伪影,以及图像的错误合并部分。

快速移动的公共汽车在一阵图像中。左:没有鲁棒性模型的合并。右:与鲁棒性模型合并。

推动移动摄影的最新发展 去年

的人像模式,以及之前的HDR+流程,展示了移动摄影的出色表现。今年,我们开始为缩放做同样的事情。这是提升计算摄影技术水平的又一步,同时缩小了移动摄影和数码单反相机之间的质量差距。这是一张包含完整 FOV 图像的相册,然后是 Super Res Zoom 图像。请注意,这张专辑中的 Super Res Zoom 图像没有被裁剪——它们是使用捏合缩放直接在设备上捕获的。

超分辨率的想法比智能手机的出现早了至少十年。几乎同样长的时间,它也通过电影和电视生活在公众的想象中。它已成为学术期刊和会议上数千篇论文的主题。现在,它是真实的——在您的手掌中,在 Pixel 3 中。

Super Res Zoom 的说明性动画。当用户拍摄放大的照片时,Pixel 3 会利用用户的自然手部动作,在细微的不同位置捕捉一连串图像。然后将它们合并在一起,为最终图像添加细节。

致谢

Super Res Zoom 是 Google 多个团队合作的结果。如果没有 Peyman Milanfar、Marc Levoy 和 Bill Freeman 管理的团队的共同努力,该项目是不可能实现的。作者要特别感谢 Marc Levoy 和 Isaac Reynolds 在撰写此博客时提供的帮助。

作者特别感谢 Super Res Zoom 项目的以下主要贡献者:Ignacio Garcia-Dorado、Haomiao Jiang、Manfred Ernst、Michael Krainin、Daniel Vlasic、Jiawen Chen、Pascal Getreuer 和 Chia-Kai Liang。该项目还得益于 Ce Liu、Damien Kelly 和 Dillon Sharlet 的贡献和反馈。

如何充分利用 Super Res Zoom?

以下是在 Pixel 3 手机上充分利用 Super Res Zoom 的一些提示:

- 捏合和缩放,或使用 + 按钮以离散步骤增加缩放。

- 双击预览可在放大和缩小之间快速切换。

- Super Res 在所有变焦倍数下都运行良好,但出于性能原因,它仅在 1.2 倍以上时才激活。这大约是在缩放 UI 中没有缩放和第一次“点击”之间的一半。

- 广角相机的光学分辨率存在基本限制。因此,要充分利用(任何)变焦,请保持放大倍数适中。

- 避免快速移动的物体。Super Res Zoom 将正确捕捉它们,但您不太可能获得更高的分辨率。

*值得注意的是,这种情况在某些方面与我们的观察方式相似——在人类(和其他哺乳动物)的眼睛中,不同的视锥细胞对某些特定的颜色敏感,大脑会填充细节以重建完整的图像。↩

本文地址: 辰风补充:Pixel 3 上的 Super Res Zoom(Sabre,即军刀算法) 让您看得更清楚、更远